Le compromis gagnant entre performance et efficacité

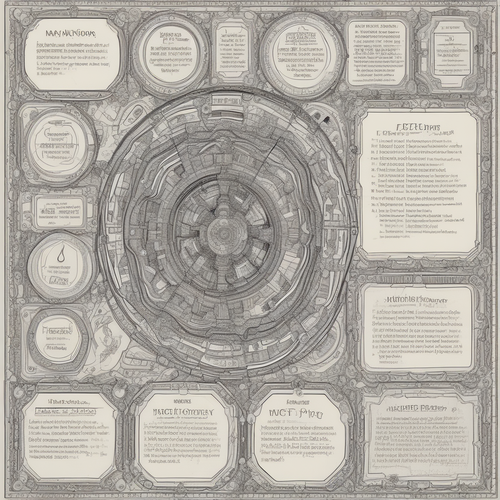

Mistral AI a dévoilé son nouveau modèle de langage open source Mixtral 8x22B, qui se positionne comme une alternative crédible à Llama 3 de Meta. Bien que légèrement moins performant sur certains benchmarks, Mixtral se distingue par son architecture innovante de Sparse Mixture-of-Experts, offrant une excellente efficacité en termes de coût et de rapidité d’inférence. Mixtral peut ainsi s’avérer un choix judicieux pour de nombreux cas d’usage, notamment en analyse de documents complexes, en mathématiques et en génération/compréhension de code.

Points clés

- Mixtral 8x22B est un nouveau modèle de langage open source développé par la start-up française Mistral AI

- Il dispose d’une architecture Sparse Mixture-of-Experts, plus compacte et efficace que l’architecture transformer classique

- Bien que légèrement moins performant que Llama 3 de Meta sur certains benchmarks, Mixtral offre de meilleures performances en mathématiques et en programmation

- Mixtral utilise seulement 39 milliards de paramètres actifs sur 141 milliards au total, contre 70 milliards pour Llama 3, le rendant plus rapide et moins coûteux à déployer

- Mixtral excelle notamment dans l’analyse de documents complexes, la génération/compréhension de code et les tâches nécessitant un raisonnement complexe

- Le modèle français peut être fine-tuné sur un langage spécifique pour encore améliorer ses performances

À retenir

Avec Mixtral 8x22B, Mistral AI a réussi à développer un modèle de langage open source qui se positionne comme une alternative crédible à Llama 3 de Meta. Bien que légèrement moins performant sur certains benchmarks, Mixtral compense par son architecture innovante et son excellente efficacité, le rendant plus rapide et moins coûteux à déployer. Pour de nombreux cas d’usage, Mixtral pourrait s’avérer être le meilleur choix, à condition de bien le guider avec un prompt adapté. La bataille de l’IA open source n’a pas fini de faire rage !

Sources