SmolLM : des modèles de langage petits mais puissants

Une nouvelle ère pour les modèles...

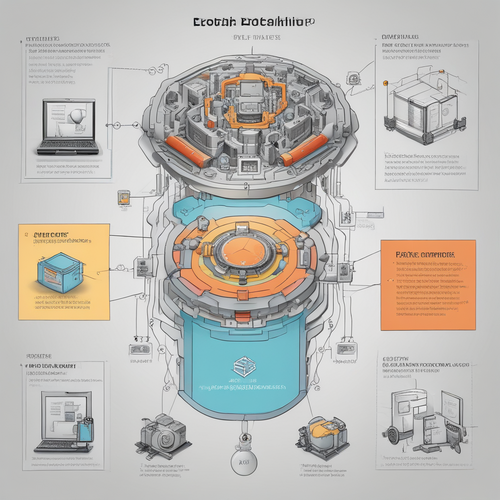

OpenDiLoCo : Un cadre open-source pour l’entraînement distribué à faible communication

Démocratiser l’entraînement des modèles d’IA à...

Un mélange d’experts à grande échelle pour une mise à l’échelle efficace des modèles de transformateurs

Une nouvelle architecture MoE avec un...

NuExtract : Un modèle de fondation pour l’extraction structurée

Un modèle compact et performant pour...

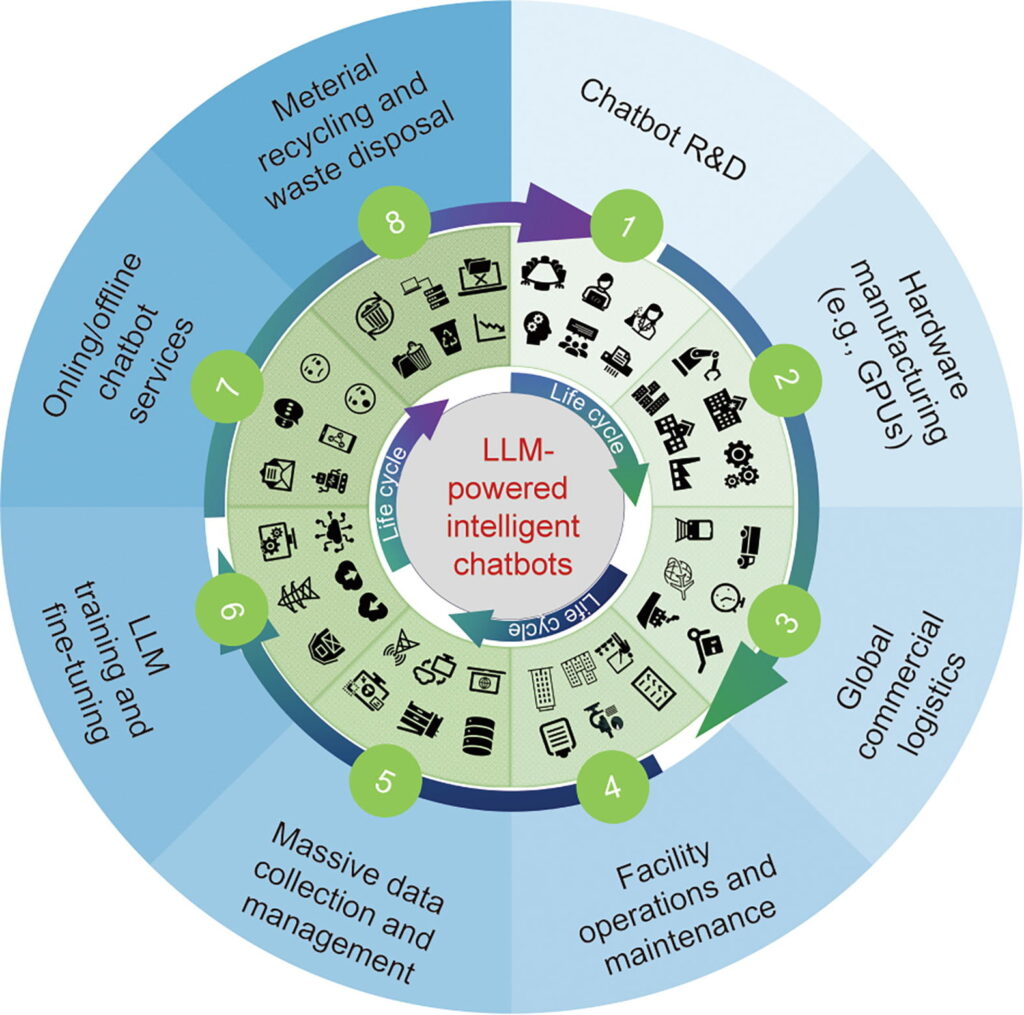

Réduire l’empreinte écologique des agents conversationnels à l’ère de l’IA générative

Optimiser la durabilité des chatbots alimentés...

Tout savoir sur les LLMs : un tour d’horizon

Analyse des principaux modèles de langage...

Les enjeux de transparence des LLMs

L’opacité des LLM et les solutions...

Déchiffrer le modèle CLIP, la pierre angulaire de l’IA multimodale

Le fonctionnement révolutionnaire du modèle CLIP...

Qwen2 : L’évolution majeure des modèles de langage open-source

Une nouvelle génération de modèles de...

MADRID : Diagnostics multi-agents pour la robustesse via la diversité éclairée

Améliorer la résilience des systèmes multi-agents...

Atterrir dans le LoRA Land : 310 LLM affinés rivalisent avec GPT-4

Des modèles de langage affinés avec...