Internet n’est pas assez développé pour former l’IA, mais une solution existe : les fausses données

Solutions innovantes pour l’IA en manque...

Les Modèles d’IA S’Effondrent Lorsqu’ils Sont Formés sur des Données Générées Récursivement

Risques de l’entraînement des LLM avec...

Avancées et Défis des Assistants de Connaissance selon Jerry Liu de Llama Index

Les innovations dans les assistants intelligents...

Modèles Linguistiques et Innovations Technologiques

Exploration des meilleures pratiques et opportunités...

Groq : Révolutionnez l’inférence IA avec l’Unité de Traitement du Langage LPU™

LPU™ : Une avancée majeure pour...

SmolLM : des modèles de langage petits mais puissants

Une nouvelle ère pour les modèles...

Tendances Technologiques 2024 : McKinsey Anticipe l’Avenir de l’Innovation

Innovations clés pour l’année à venir...

Optimiser les Longs Prompts avec le Corpus-In-Context Prompting

Techniques pour améliorer les modèles LLM...

Entraînement de modèles Mamba sur des GPU AMD MI250/MI250X avec des noyaux personnalisés

Exploiter la puissance des GPU AMD...

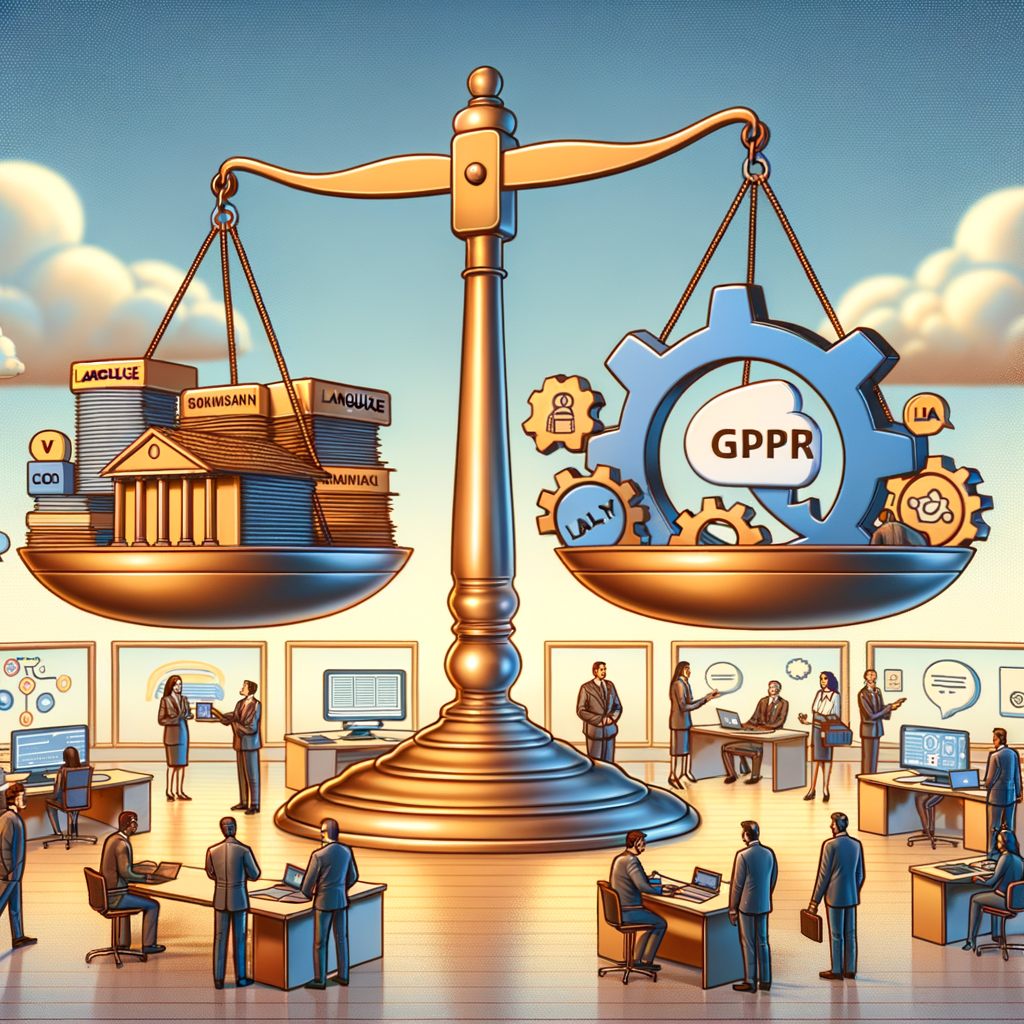

L’IA soulève des questions de protection des données et de confidentialité

Luiza Jarovsky analyse les enjeux de...

Applicabilité du RGPD aux modèles de langage à grande échelle : Analyse juridique et implications pratiques

Comprendre les enjeux juridiques liés à...

Un cadre open-source pour l’entraînement distribué à faible communication à l’échelle mondiale : OpenDiLoCo

Résumé détaillé d’OpenDiLoCo, un outil révolutionnaire...