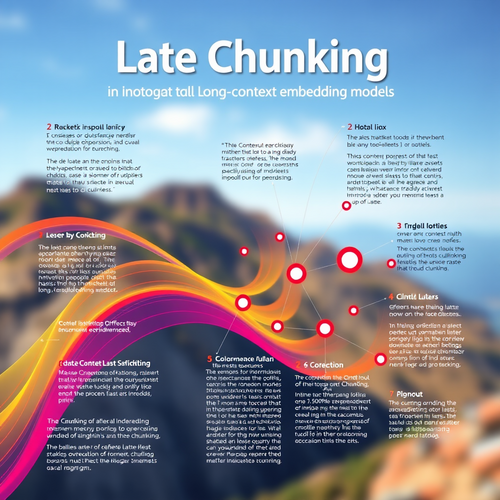

Optimiser l’Embedding avec le Late Chunking

Dans cet article, nous explorons le concept de “Late Chunking”, une approche novatrice pour améliorer l’efficacité des modèles d’embedding à long contexte. En se basant sur des modèles capables de traiter jusqu’à 8192 tokens, cette méthode permet de préserver les dépendances contextuelles essentielles lors de l’encodage de textes longs. Les résultats montrent que le Late Chunking surpasse les méthodes traditionnelles d’encodage, surtout pour des documents plus longs.

Points clés

- En octobre 2023, Jina a lancé le premier modèle d’embedding open-source avec une longueur de contexte de 8K.

- Le modèle “jina-embeddings-v2-base-en” permet de traiter jusqu’à 8192 tokens.

- La méthode traditionnelle de chunking peut entraîner une perte d’informations contextuelles importantes.

- Le Late Chunking conditionne chaque chunk d’embedding sur les précédents, améliorant ainsi la qualité des représentations vectorielles.

- Les résultats des tests sur des benchmarks comme BeIR montrent une amélioration significative des scores nDCG@10 avec le Late Chunking par rapport au chunking naïf.

À retenir

Eh bien, si vous pensiez que le simple fait de découper des textes en morceaux aléatoires était suffisant, détrompez-vous ! Le Late Chunking prouve que même dans le monde des embeddings, il faut parfois prendre un peu de recul et considérer le contexte. Après tout, qui aurait cru que la clé d’un bon embedding résidait dans la manière dont on découpe le texte ?

Sources