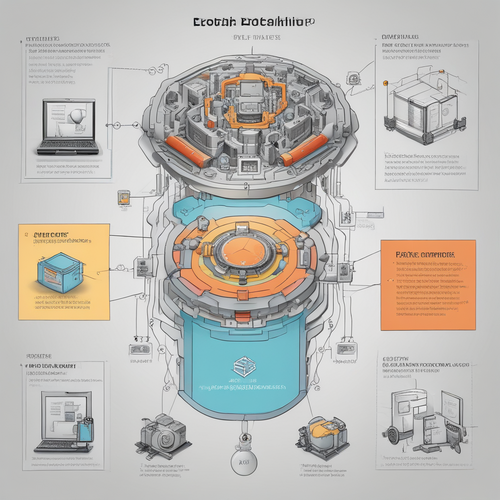

Une nouvelle architecture MoE avec un routage efficace vers plus d’un million d’experts

Cet article présente une nouvelle architecture MoE (Mélange d’Experts) appelée PEER (récupération efficace des paramètres des experts) qui permet une mise à l’échelle efficace des modèles de transformateurs en utilisant un très grand nombre d’experts minuscules (plus d’un million). En combinant un mécanisme de récupération par clés de produit et des experts à neurone unique, PEER surpasse les transformateurs denses et les MoE à granularité grossière en termes de compromis performance-calcul.

Points clés

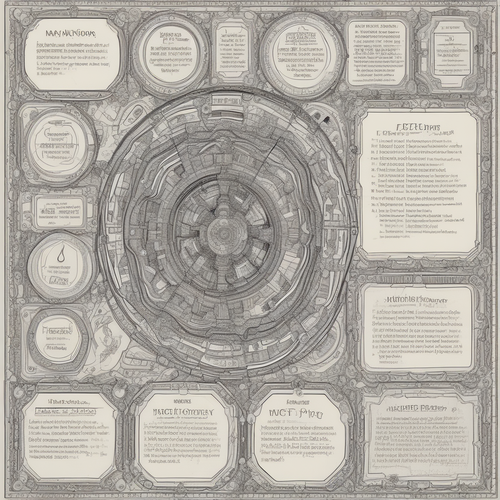

- Les couches feedforward (FFW) représentent les deux tiers des paramètres totaux d’un transformateur, mais leur coût de calcul augmente linéairement avec leur taille

- Les architectures MoE permettent de découpler la taille du modèle du coût de calcul en utilisant un ensemble d’experts activés de manière clairsemée

- La découverte récente de la loi d’échelle fine du MoE montre qu’une granularité plus fine (plus d’experts) conduit à de meilleures performances

- Cependant, les modèles MoE existants se limitent à un petit nombre d’experts en raison de défis computationnels et d’optimisation

- PEER utilise la technique des clés de produit pour un routage efficace vers un pool de plus d’un million d’experts minuscules

- Les expériences montrent que PEER surpasse les transformateurs denses et les MoE à granularité grossière en termes d’efficacité calcul-performance

À retenir

Avec cette nouvelle architecture PEER capable de gérer un nombre massif d’experts minuscules, les chercheurs ont franchi une étape importante vers une mise à l’échelle plus poussée et plus efficace des modèles de transformateurs. Bien que les défis techniques restent importants, cette approche innovante ouvre la voie à des progrès significatifs dans l’amélioration des performances des grands modèles de langage tout en maintenant une efficacité computationnelle élevée.

Sources

Quiz sur le document: 10 questions