Biais algorithmique : l’IA médicale sous la loupe

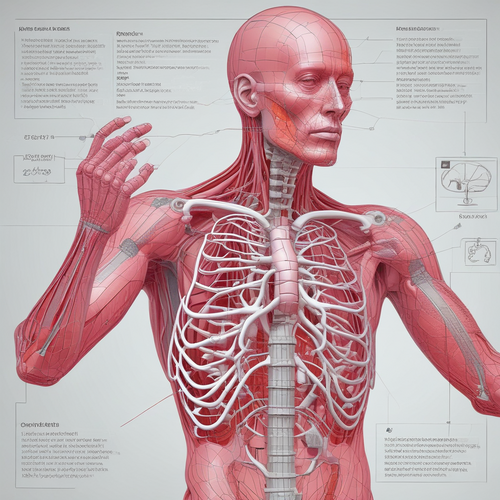

Une étude menée par des chercheurs du MIT révèle que les modèles d’IA utilisés pour analyser les images médicales, comme les radiographies, peuvent présenter des biais importants envers certains groupes démographiques, notamment les femmes et les personnes de couleur. L’étude souligne que ces modèles peuvent utiliser des “raccourcis démographiques” pour faire des prédictions, ce qui conduit à des résultats inexacts pour certains groupes. Les chercheurs ont également constaté que la formation des modèles sur des données spécifiques à un hôpital peut améliorer leur équité, mais que cette équité peut être compromise lorsqu’ils sont appliqués à des patients d’autres hôpitaux.

Points clés

- Les modèles d’IA utilisés pour analyser les images médicales peuvent présenter des biais envers certains groupes démographiques, notamment les femmes et les personnes de couleur.

- Les modèles d’IA peuvent prédire la race d’un patient à partir de sa radiographie thoracique, même si les radiologues les plus expérimentés ne peuvent pas le faire.

- Les modèles les plus précis pour prédire les attributs démographiques présentent également les plus grands écarts d’équité, suggérant qu’ils utilisent des “raccourcis démographiques” pour faire des prédictions.

- Les chercheurs ont constaté qu’ils pouvaient retrainer les modèles pour améliorer leur équité, mais que cette équité est souvent limitée aux données utilisées pour la formation.

- Les modèles d’IA utilisés en radiologie ont été approuvés par la FDA, mais il est important de les évaluer sur la population de patients d’un hôpital avant de les utiliser.

- Les chercheurs recommandent de former les modèles d’IA sur des données spécifiques à un hôpital pour améliorer leur équité et réduire les biais.

- Les modèles d’IA utilisés en radiologie sont souvent formés sur des données d’un seul hôpital, ce qui peut conduire à des biais lorsqu’ils sont appliqués à des patients d’autres hôpitaux.

- Les chercheurs étudient des méthodes pour améliorer l’équité des modèles d’IA utilisés en radiologie et réduire les biais.

À retenir

Il semblerait que l’IA, même dans le domaine médical, ne soit pas à l’abri des biais. On pourrait presque dire que l’IA est un peu comme un élève qui apprend ses leçons par cœur sans vraiment comprendre le sujet. Elle peut être très performante sur des données similaires à celles sur lesquelles elle a été formée, mais dès qu’on lui présente un nouveau cas, elle se retrouve un peu perdue. Alors, avant de se laisser séduire par les promesses de l’IA dans le domaine médical, il est important de se rappeler que la vigilance est de mise. Il faut s’assurer que les modèles sont formés sur des données représentatives et qu’ils sont évalués sur des populations diverses pour éviter de reproduire les inégalités du monde réel.

Sources