Débat sur les limites éthiques de l’IA dans le processus de deuil

Cet article analyse les enjeux éthiques et anthropologiques de l’utilisation de l’intelligence artificielle pour accompagner les personnes en deuil. Il met en lumière les différences entre les rituels traditionnels de deuil et l’approche désincarnée de l’IA, qui risque d’amplifier l’isolement et les fantasmes des endeuillés. L’auteur plaide pour une régulation plus stricte de ces applications d’IA, afin de préserver la dignité et la santé mentale des personnes confrontées à la perte d’un proche.

Points clés

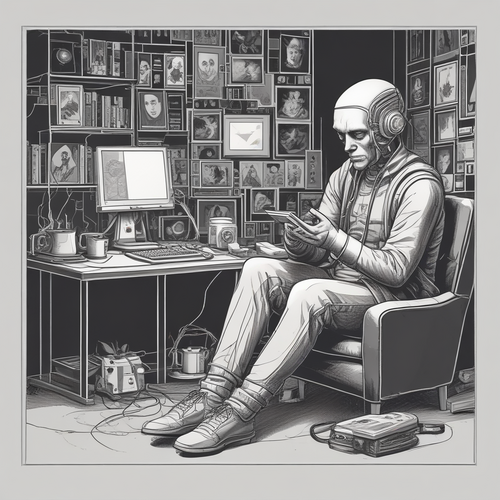

- L’application “Project December” permet de discuter avec un agent conversationnel simulant les propos d’une personne décédée

- Cette approche ignore les enjeux anthropologiques et psychologiques du processus de deuil, présents dans les rituels traditionnels

- Les rituels de deuil offrent un cadre collectif, des médiateurs humains et des temps de silence, absents dans l’interaction avec l’IA

- L’IA risque d’amplifier l’isolement et les fantasmes des endeuillés, en les laissant seuls face à un dialogue simulé

- Les régulateurs comme l’UE et les États-Unis doivent prendre en compte ces enjeux éthiques dans l’encadrement de l’IA

À retenir

Bien que l’IA puisse sembler offrir une solution pratique pour dialoguer avec les disparus, cette approche fait fi des processus de deuil ancestraux et des besoins psychologiques fondamentaux des endeuillés. Les régulateurs doivent impérativement encadrer ces applications d’IA afin de préserver la dignité et la santé mentale des personnes confrontées à la perte d’un être cher. Sinon, on risque de voir se développer une “ubérisation” des rituels de deuil, au détriment du bien-être des endeuillés. Il est temps de replacer l’humain au cœur de ces moments cruciaux de la vie.

Sources