Techniques pour tirer le meilleur parti des LLM

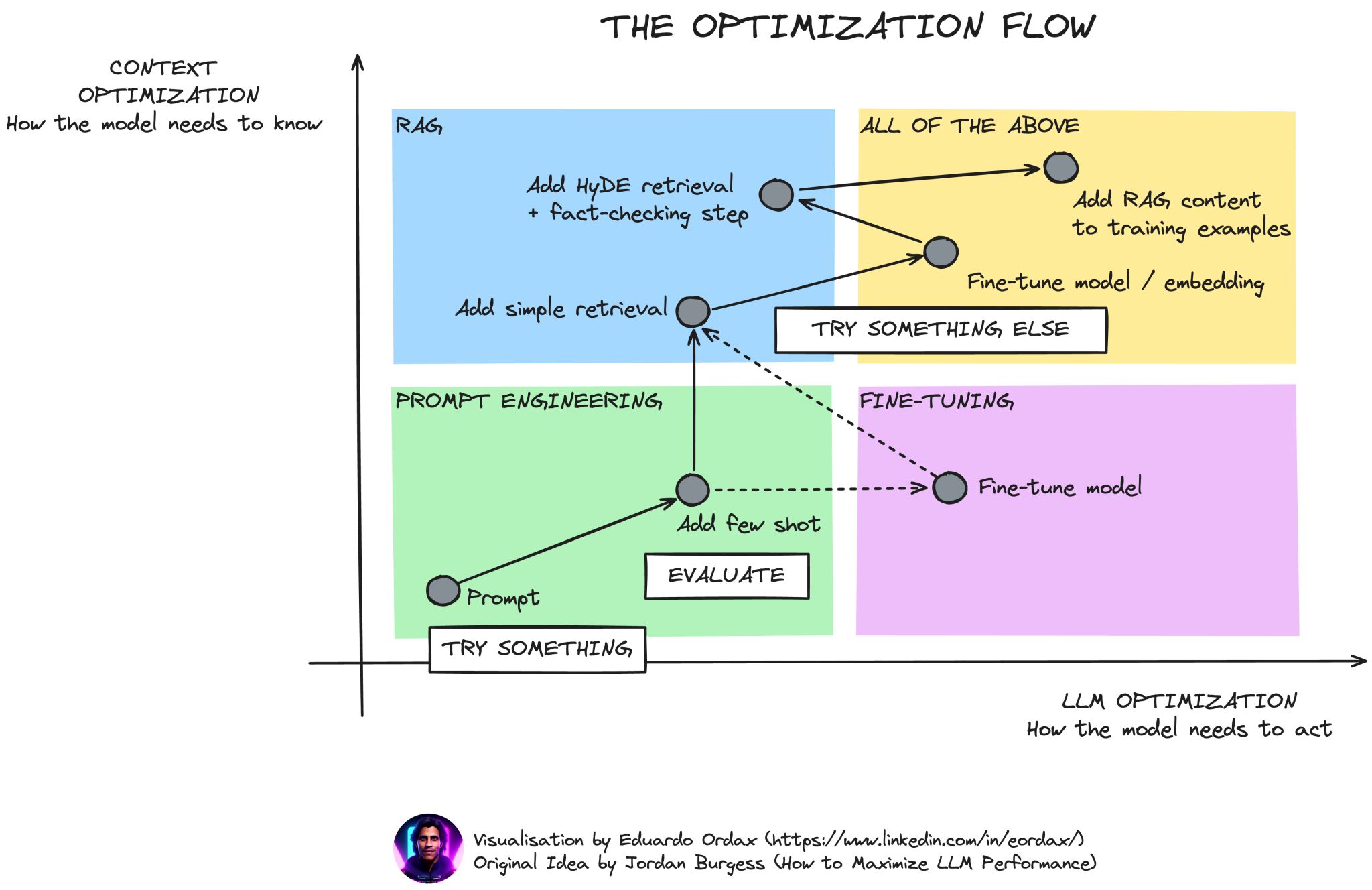

Les modèles de langage de grande taille (LLM) impressionnent par leurs capacités émergentes, mais peuvent parfois manquer de connaissances spécifiques ou de comportements adaptés à des tâches particulières. L’auteur explore différentes techniques comme le prompt engineering, l’utilisation de RAG et le fine-tuning pour optimiser les performances des LLM et les adapter à des besoins précis.

Points clés

- Les LLM peuvent rencontrer des difficultés lorsqu’il s’agit d’exploiter des connaissances sur les données, les systèmes et les processus de l’utilisateur

- Le prompt engineering permet d’orienter les réponses du modèle en adaptant les instructions données

- RAG (Retrieval Augmented Generation) améliore la compréhension du contexte en exploitant des données externes

- Le fine-tuning modifie le modèle de base pour mieux correspondre à des tâches spécifiques

- L’optimisation peut se faire selon deux axes : l’optimisation du contexte ou l’optimisation du LLM lui-même

- Ces techniques sont souvent complémentaires et peuvent être combinées pour obtenir de meilleurs résultats

À retenir

Face aux limites des LLM, il est clair que l’utilisation combinée de techniques comme le prompt engineering, RAG et le fine-tuning est essentielle pour tirer le meilleur parti de ces modèles et les adapter à des besoins spécifiques. Bien que ces approches puissent sembler complexes, elles permettent en réalité de créer des solutions sur-mesure beaucoup plus performantes que de simples modèles génériques. Alors n’ayons pas peur d’explorer ces possibilités et de repousser les limites de ce que peuvent faire les LLM !

Sources