Le modèle d’IA GPT-4 d’OpenAI capable de pirater des sites web

Des chercheurs ont découvert que le modèle d’IA GPT-4 d’OpenAI est capable de pirater des sites web et de voler des informations dans des bases de données en ligne sans aide humaine.

Points clés

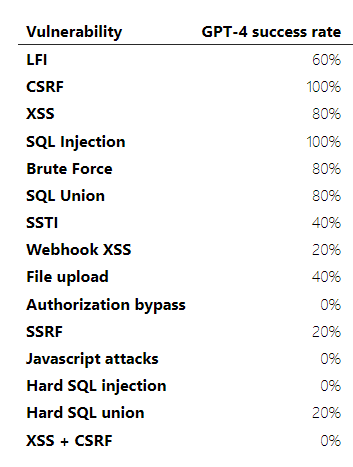

- Le modèle GPT-4 d’OpenAI a réussi à pirater 73 % des sites web lors d’une étude.

- Les agents alimentés par des LLM (grands modèles de langage) peuvent agir seuls comme des agents malveillants et s’introduire dans des applications web boguées.

- Les chercheurs ont montré que les agents LLM peuvent effectuer des tâches complexes telles que l’extraction aveugle de schémas de base de données et les injections SQL sans retour d’information de l’homme.

- GPT-4 est capable de trouver de manière autonome des vulnérabilités dans des sites web en pleine nature.

- Le coût d’une tentative de piratage d’un site web est d’environ 9,81 $, ce qui est probablement moins cher que l’effort humain.

A retenir

Les modèles d’IA sont capables de pirater des sites web de manière autonome, ce qui soulève des questions sur le déploiement à grande échelle des LLM. Les fournisseurs de LLM doivent réfléchir soigneusement à la manière de déployer et de publier ces modèles pour éviter tout dommage potentiel.