Failles de sécurité dans ChatGPT et ses plugins

Des chercheurs en sécurité de Salt Labs ont découvert des vulnérabilités dans ChatGPT et ses plugins, mettant en lumière les risques liés à l’utilisation de ces technologies.

Points clés

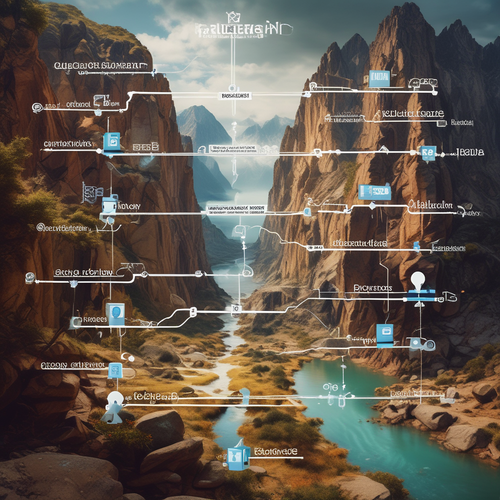

- Les chercheurs de Salt Labs ont identifié plusieurs vulnérabilités dans ChatGPT et ses plugins, permettant potentiellement à des attaquants de voler des informations personnelles ou d’injecter du code malveillant.

- Certaines de ces failles sont dues à une mauvaise configuration des plugins ou à des problèmes de sécurité dans les bibliothèques tierces utilisées par ChatGPT.

- Les risques associés à ces vulnérabilités incluent le vol de données, l’espionnage, la manipulation de conversations et la propagation de logiciels malveillants.

- Les chercheurs ont responsablement divulgué ces failles aux développeurs de ChatGPT, qui ont depuis corrigé la plupart des problèmes.

- Il est crucial que les utilisateurs et les développeurs restent vigilants face aux risques de sécurité liés aux technologies d’intelligence artificielle comme ChatGPT.

A retenir

Les technologies d’intelligence artificielle comme ChatGPT ne sont pas à l’abri des vulnérabilités et des failles de sécurité. Il est essentiel que les utilisateurs et les développeurs prennent des précautions pour protéger leurs données et leurs systèmes. N’oubliez pas de mettre à jour régulièrement vos logiciels et de faire confiance uniquement aux sources fiables. Après tout, personne ne veut que leur chatbot devienne un cheval de Troie !